在 Obsidian 中通过 Copilot 插件调用 NVIDIA NIM (NVIDIA Inference Microservices) 提供的免费 Llama 模型,可以让你无需本地高性能显卡,就能体验到万亿参数级(如 Llama 3.1 405B)的推理速度。

以下是针对 2026 年最新接口的配置教程:

—

第一步:获取 NVIDIA API Key

NVIDIA 为开发者提供了一定额度的免费积分(通常新用户有 1000~5000 积分),足以支撑数月的日常笔记辅助。

访问 [链接登录后可见]。

在搜索框输入 Llama,选择你想要使用的版本(如 meta/llama-3.1-405b-instruct 或最新的 llama-3.3)。

点击页面上的 “Get API Key”。

登录 NVIDIA 账号(支持邮箱注册)。

生成并复制 API Key(格式通常以 nvapi- 开头)。

—

第二步:在 Obsidian 中配置 Copilot

由于 Copilot 插件默认列表可能未直接列出 NVIDIA,我们需要通过 Custom Model(自定义模型) 方式接入,因为 NVIDIA 的接口完全兼容 OpenAI 格式。

打开 Obsidian Settings > Copilot。

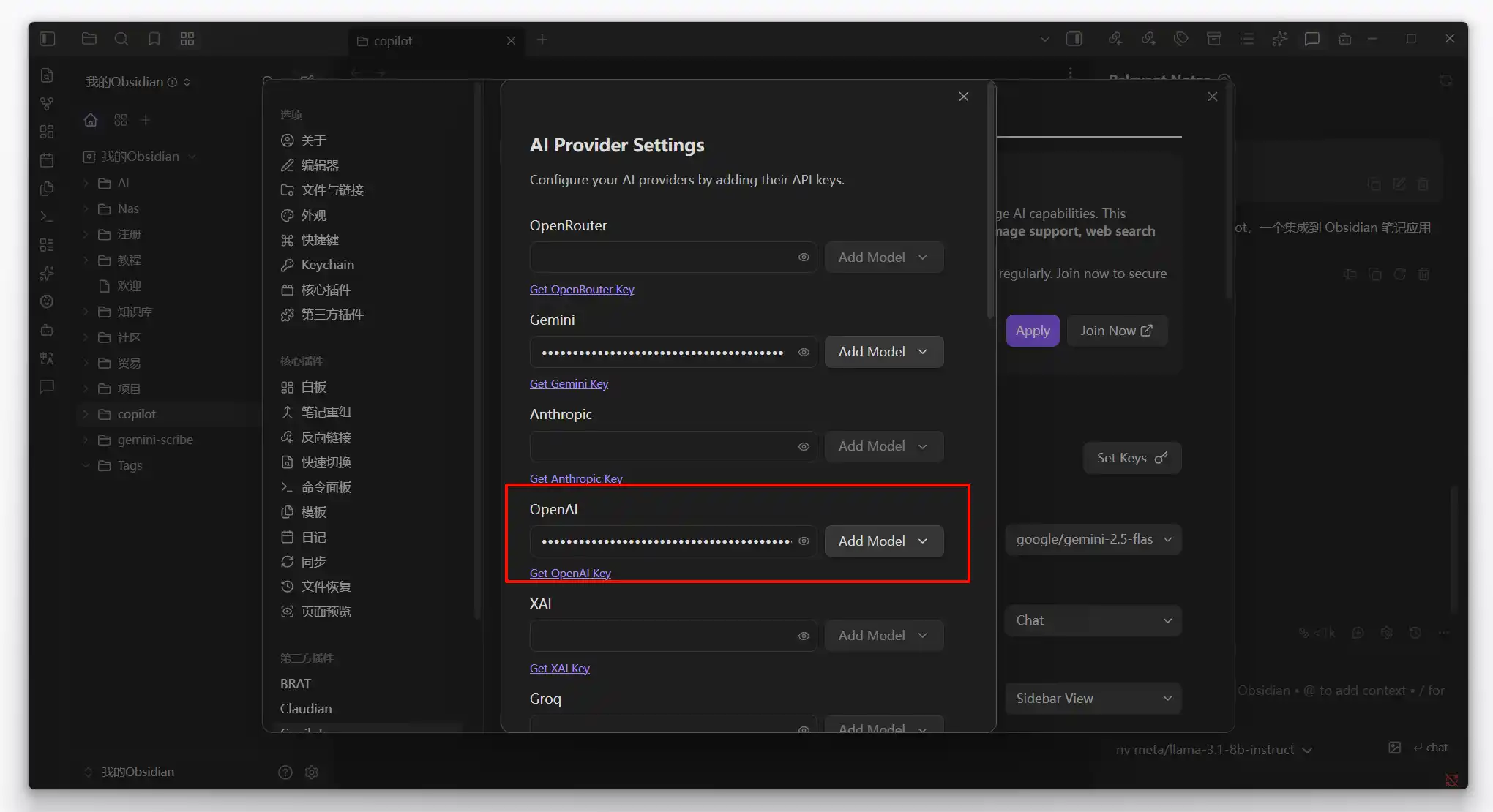

进入 Basic Settings > API Keys。

在最下方的 Custom API Key 区域,输入你刚才复制的 nvapi-xxx。

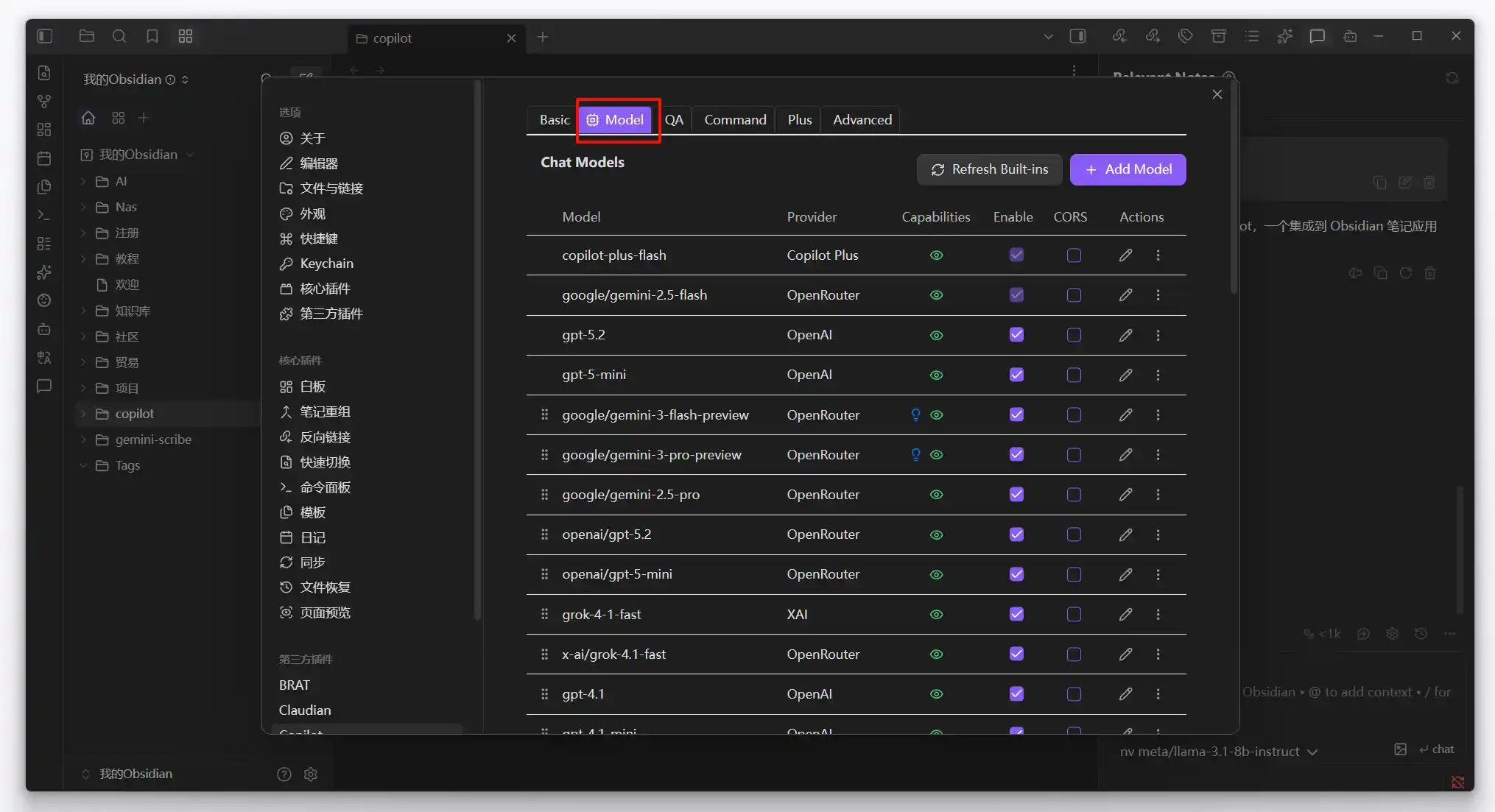

返回 Copilot 设置主界面,找到 Default Model 下方的 “Add Model” 按钮。

—

第三步:填写 NVIDIA 节点参数

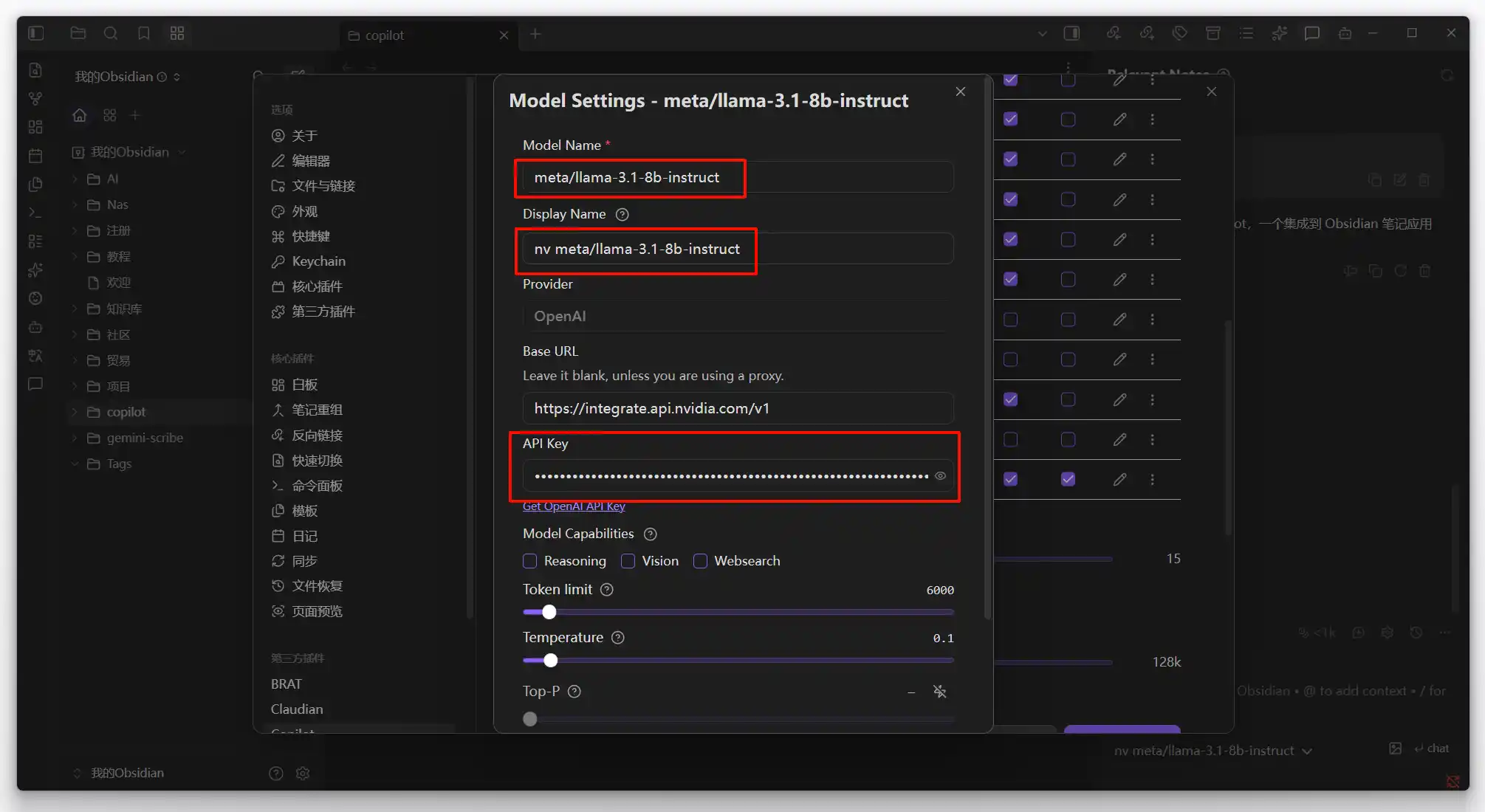

在弹出的自定义模型表单中,请严格按照以下参数填写:

| 配置项 | 填写内容 |

|---|

| Model Name | meta/llama-3.1-405b-instruct (需与官网 ID 一致) |

| Provider | 3rd party (openai format) |

| Base URL | https://integrate.api.nvidia.com/v1 |

| API Key | 填入你的 NVIDIA API Key |

填写完成后点击 Add。

—

第四步:启用与测试

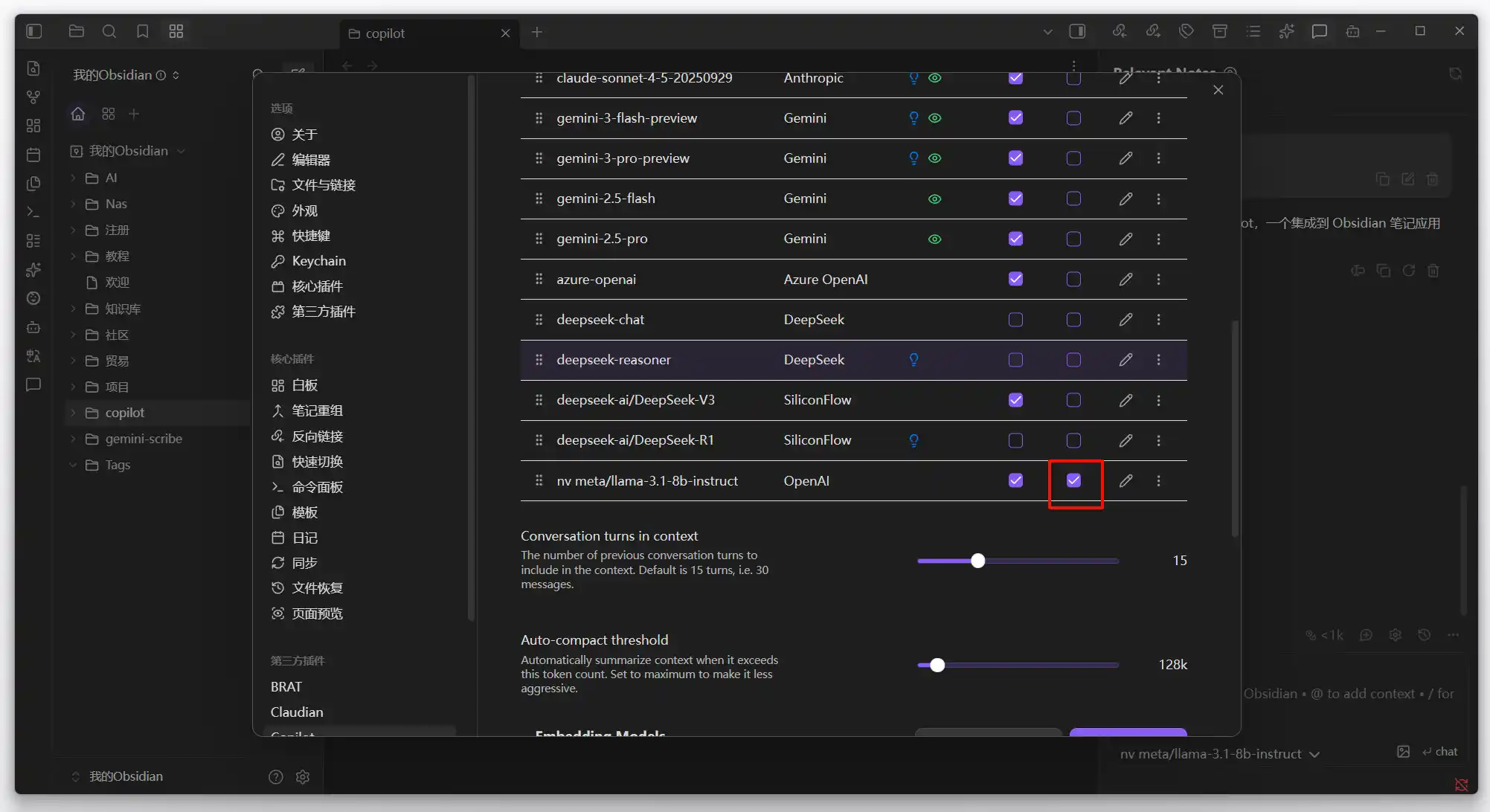

在 Copilot 侧边栏的对话窗口顶部,点击模型下拉菜单。

滚动到最下方,选择你刚刚添加的 meta/llama-3.1-405b-instruct。

随便输入一个问题测试,例如:“你好,请用一句话证明你现在是跑在 NVIDIA 算力中心上的。”

—

💡 技巧

NVIDIA 的免费额度是基于积分的。你可以在 NVIDIA API Dashboard 实时查看剩余积分。